所有語言

分享

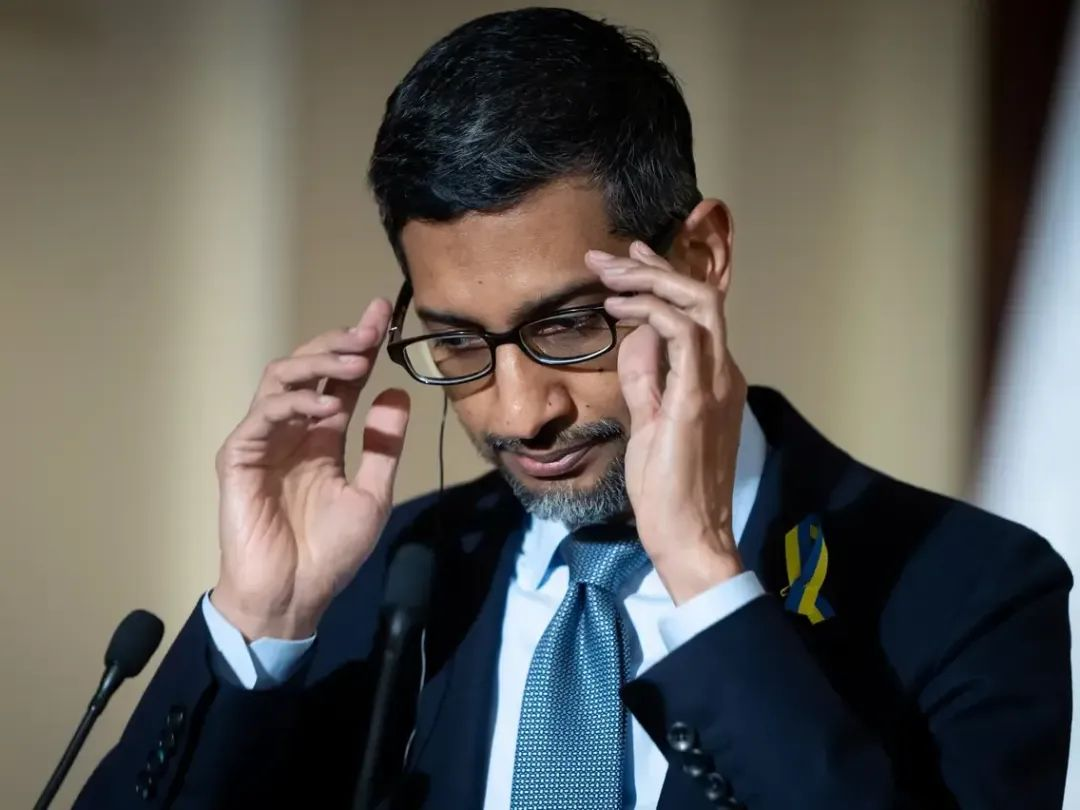

谷歌CEO承認其人工智能完全搞砸了

文章來源:AI范兒

谷歌最近的Gemini AI引擎事件引發了公眾關注。該引擎生成多元化的納粹圖片,引發了困擾。CEO桑達爾·皮查伊向員工發出警告,表示錯誤不可容忍。儘管谷歌正在努力解決問題,但這次事件突顯了人工智能的挑戰。

谷歌在最近一周半遭遇了一場災難。上周,其最近改名的Gemini AI引擎突然開始生成多元化的納粹圖片,這一舉動引發了網絡上的困惑和不滿,因為這種做法不僅缺乏審美品位,還歷史事實不準確。

據報道,谷歌高級副總裁普拉巴卡爾·拉加萬在上周五的一篇博文中承認了這一失誤,他表示:“我們對Gemini進行了調整,以展示各種人群,但我們沒有考慮到明顯不應該展示各種人群的情況。”

這一事件迅速引起了主流媒體的廣泛關注,並被渲染成了一場公關危機。作為回應,谷歌禁止了系統生成任何人物的圖像。

然而,更為尷尬的是,接下來還出現了更多令人尷尬的揭示,比如其聊天機器人拒絕回答種族滅絕獨裁者阿道夫·希特勒是否比特斯拉CEO埃隆·馬斯克更糟糕的問題。

谷歌CEO桑達爾·皮查伊對此感到非常憤怒,他在周二通過郵件向員工發出了警告。

“我知道有些回答已經冒犯了我們的用戶並顯露出偏見,明確地說,這是完全不能容忍的,我們錯了。”他寫道,並強調谷歌的“使全球信息有組織並普遍可訪問和有用的使命是不可侵犯的。”

這對於谷歌這樣的科技巨頭來說是一個特別危險的處境,因為谷歌在新興的人工智能競爭中一直處於下風,難以跟上像OpenAI等激烈競爭對手的步伐。

為了安撫員工,皮查伊向他們保證Gemini還沒有完全失去理智。“我們的團隊一直在全力以赴地解決這些問題。”他寫道。“我們已經在各種提示上看到了實質性的改善。”

然而,他對這一奇怪事件的解釋卻顯得模糊而不盡人意。“沒有人工智能是完美的,尤其是在這個行業發展初期,但我們知道我們的標準很高,我們會繼續努力,直到解決問題,並確保規模化。”皮查伊辯解道。“我們會審查發生了什麼,並確保我們在規模上解決問題。”

總的來說,這一事件給強大的科技公司敲響了一記警鐘:雖然製造出一個能生成文本或圖像的人工智能相對容易,但測試其是否存在所有用戶可能遇到的問題卻非常困難。正如谷歌似乎正在實時學習的,當人工智能公開出現問題時,會尷尬至極。