所有語言

分享

華為、清華等開源超高清、精準文生圖模型,0.5秒極速生成!

文章來源:AIGC開放社區

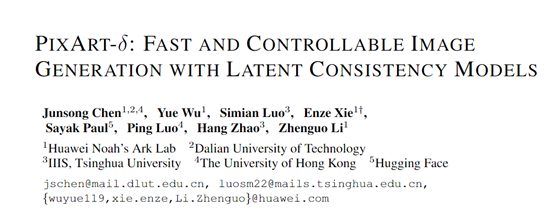

華為諾亞方舟實驗室、清華大學信息科技學院、大連理工、香港大學和Hugging Face的研究人員,聯合開源了超高清文生圖模型——PIXART-δ。

研究人員將潛在一致性模型(LCM)和創新控制架構ControlNet-Transformer集成在PIXART-δ中,在文生1024*1024高質量圖像方面實現了重大技術突破,僅用0.5秒2-4個推理步驟就能完成圖像生成,這也比之前的PIXART-{\alpha}模型快了7倍。

此外,PIXART-δ在ControlNet-Transformer幫助下,可以在不同條件下對生成模型的輸出進行精確控制,例如,圖像的邊緣、深度、分割和對象姿勢等,有點類似OpenAI的DALL·E 3。

開源地址:https://github.com/PixArt-alpha/PixArt-alpha

論文地址:https://arxiv.org/abs/2401.05252

在線Demo:https://huggingface.co/spaces/PixArt-alpha/PixArt-LCM

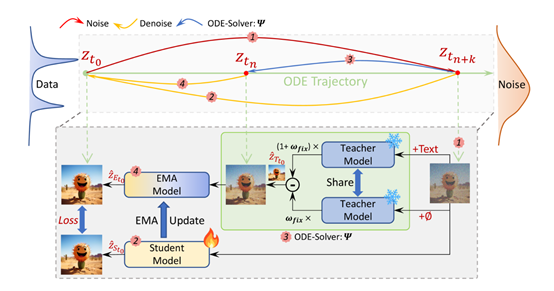

潛在一致性模型

LCM是一種用於加速生成模型的全新高效方法,核心技術是將生成模型的反向採樣過程,看成是解決一個增強的概率流動常微分方程(PF-ODE)流程。

傳統的生成模型是通過迭代採樣的方式生成圖像,需要繁瑣的步驟並且每個步驟都需要大量的AI計算資源和時間。

而LCM通過預測增強的PF-ODE方法,將生成過程簡化為幾個微小步驟,以幫助模型用最快的速度生成高質量的圖像。

PF-ODE主要描述了圖像生成過程中的概率流動,並將每個數據點映射回其起源點。通過求解增強的PF-ODE,使得LCM可以在潛在空間中生成高質量的圖像樣本。

然後,LCM利用一致映射函數進行訓練。這個函數能夠直接從最後一個時間點,推斷出任何其他時間點上的樣本位置。所以,整個擴散回歸過程就可以直接通過求解概率流微分方程實現,而不是像傳統模型那樣需要多步迭代。

這也是為什麼PIXART-δ能用2—4個推理步驟就能生產高精準圖像的原因。

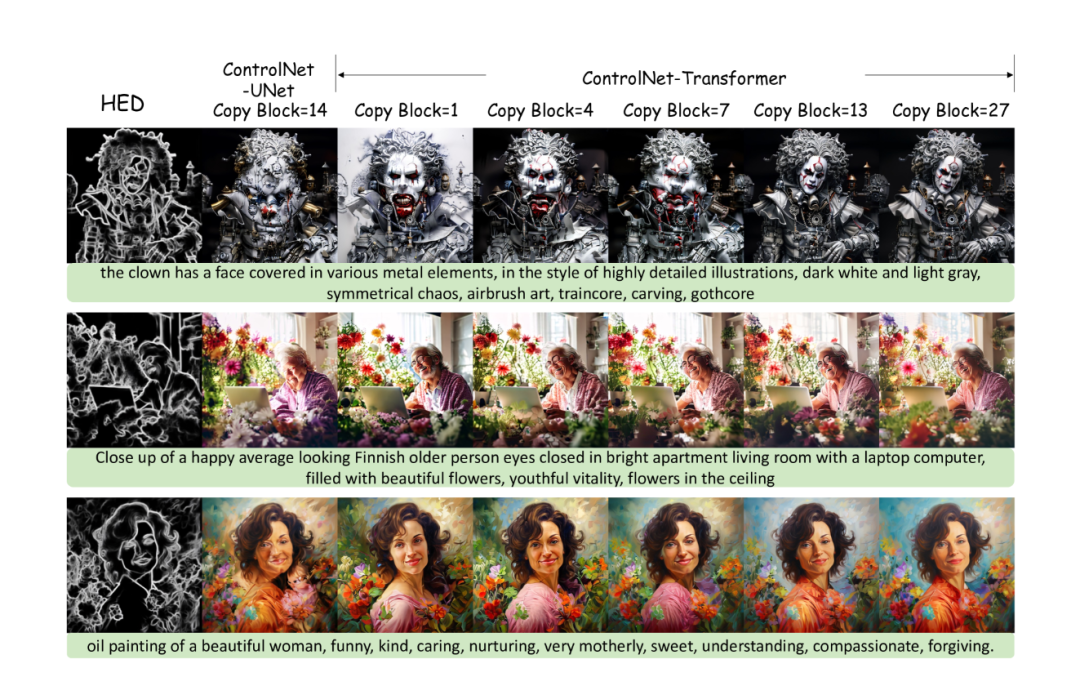

ControlNet-Transformer

ControlNet在邊緣檢測、姿態估計、草圖生成、表情表達等方面,展示了對文本生成圖像擴散模型內容輸出的優秀控制能力。

這是因為其擁有一個可訓練的UNet副本,允許對輸入條件進行操作,從而控制生成圖像的整體布局。

在訓練過程中,ControlNet凍結原始的文本到圖像擴散模型,只優化可訓練的副本。通過跳躍連接將該副本的每個層的輸出與原始UNet集成,並使用“零填充卷積”層以避免過多的AI算力負擔。

但是,ControlNet架構是針對UNet-based擴散模型精心設計的,直接複製到Transformer中效果較差。

所以,為了在Transformer架構中實現更好的精準控制能力,研究人員使用了一種創新的ControlNet-Transformer架構,並專門針對Transformer模型進行了優化和量身定製。

ControlNet-Transformer通過在解碼器中的每個解碼層之間引入跳躍連接,並使用適當的注意力機制,使得生成的圖像既具有高質量的細節,又能根據輸入的條件進行靈活的調整和控制。

PIXART-δ生成案例賞析

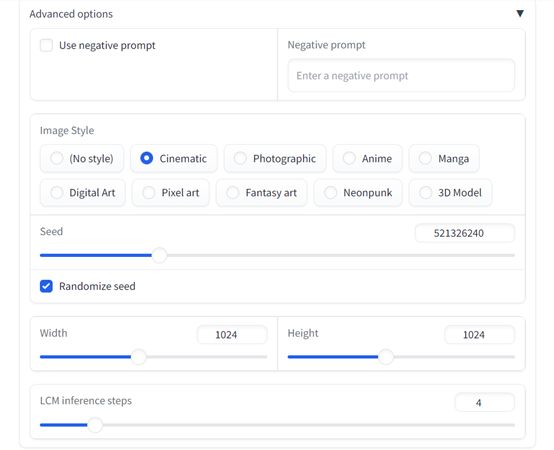

以下是「AIGC開放社區」根據在線Demo生成的圖像,整體來說生成效率非常高,語義還原精準,並且支持可視化生成流程控制,例如,生成步驟、圖像尺寸、圖像類型等,功能強大且易使用。

一隻戴着別緻紳士帽、穿着夾克的擬人貓,站在秋天的森林中的肖像照。

美麗的女孩,雀斑,笑容燦爛,藍色的眼睛,薑黃色的短髮,深色的妝容,穿着花藍色背心,柔和的光線,深灰色的背景,寫實風格。

桌子上透明罐子里壯觀的微小世界,大會堂內部,精心設計,雕刻建築,解剖,象徵,幾何和參數化細節,精確的平麵線細節,圖案,黑暗幻想和難以表達的神秘情緒,技術設計,複雜的超細節,風格化和未來主義和仿生細節,建築概念,低對比度細節,電影照明,8K,虛幻,逼真,超現實。

一艘海盜船被困在宇宙漩渦星雲中,在宇宙海灘漩渦引擎中渲染,體積照明,壯觀,環境光,光污染,電影氛圍,新藝術風格,4K,複雜的細節和紋理。